Сильный искусственный интеллект

Искусственный общий интеллект (AGI) - это интеллект машины, которая может успешно выполнять любую интеллектуальную задачу, которую может выполнить человек. Это основная цель некоторых исследований искусственного интеллекта и общая тема в научной фантастике и будущих исследованиях . Некоторые исследователи ссылаются на искусственный общий интеллект как "сильный ИИ", " полный ИИ " или как способность машины выполнять" общее интеллектуальное действие"; другие резервируют" сильный ИИ " для машин, способных испытывать сознание .

Некоторые ссылки подчеркивают различие между сильным ИИ и" прикладным ИИ "(также называемый" узким ИИ " или "слабым ИИ" ): использование программного обеспечения для изучения или выполнения конкретных задач решения проблем или рассуждения. Слабый ИИ, в отличие от сильного ИИ, не пытается выполнять весь спектр когнитивных способностей человека.

По состоянию на 2017 год, более сорока организаций по всему миру проводят активные исследования по AGI.

Требования[править]

Главная статья: когнитивная наука

Были предложены различные критерии интеллекта (наиболее известный тест Тьюринга), но на сегодняшний день нет определения, которое удовлетворяет всем. Однако, есть широкое согласие среди исследователей искусственного интеллекта, что интеллект должен сделать следующее:]

- рассуждать, использовать стратегию, решать головоломки и делать суждения в условиях неопределенности;

- представление знаний, включая знания здравого смысла;

- план;

- учиться;

- общаться на естественном языке;

- и интегрировать все эти навыки для достижения общих целей.

Другие важные возможности включают способность чувствовать (например, видеть) и способность действовать (например, перемещать и манипулировать объектами ) в мире, где должно наблюдаться разумное поведение. это включало бы способность обнаруживать опасность и реагировать на нее . Многие междисциплинарные подходы к интеллекту (например , когнитивистика, вычислительный интеллект и принятие решений), как правило, подчеркивают необходимость рассмотрения дополнительных черт, таких как воображение (воспринимается как способность формировать ментальные образы и концепции, которые не были запрограммированы) и автономия . Компьютерные системы, которые демонстрируют многие из этих возможностей, действительно существуют (например, см. вычислительное творчество , автоматизированное рассуждение , система поддержки принятия решений , робот , эволюционные вычисления, интеллектуальный агент), но еще не на человеческом уровне.

Тесты для подтверждения AGI человеческого уровня[править]

Тест Тьюринга ( Turing Test)[править]

- Машина и человек беседуют невидимым взглядом со вторым человеком, который должен оценить, кто из двух является машиной, которая проходит тест, если она может обмануть оценщика значительную часть времени. Примечание: Тьюринг не предписывает то, что должно квалифицироваться как интеллект, только то, что знание, что это машина, не должно дисквалифицировать ее.

Кофейный Тест (Возняк)[править]

- Машина требуется, чтобы войти в средний американский дом и выяснить, как сделать кофе: найти кофе-машину, найти кофе, добавить воду, найти кружку и варить кофе, нажав соответствующие кнопки.

Тест Студента Колледжа Робота (Goertzel)[править]

- Машина зачисляется в университет, принимая и проходя те же классы, что и люди, и получая степень.

Тест Занятости (Нильссон)[править]

- Машина работает экономически важную работу, выполняя по крайней мере, так же хорошо, как и люди в той же работе.

Тест мебели плоского пакета ( Тони Северинс)[править]

- Машина необходима, что распаковывает и собирает деталь плоск-упакованной мебели. Он должен прочитать инструкции и собрать деталь как описано, правильно устанавливающ все приспособления.

Тест Зеркала (Танвир Завад)[править]

- Машина должна отличать реальный объект и его отраженное изображение от зеркала.

IQ-тесты AGI[править]

Китайские исследователи Фэн Лю, Юн Ши и ин Лю провели тесты интеллекта летом 2017 года с общедоступным и свободно доступным слабым ИИ, таким как Google AI или Siri от Apple и другие. В максимуме эти ИИ достигли значения около 47, что примерно соответствует шестилетнему ребенку в первом классе. Взрослый человек в среднем достигает 100. В 2014 году были проведены аналогичные испытания, при которых ИИ достиг максимального значения 27.

Проблемы, требующие решения AGI[править]

Главная статья: AI-complete

Самые сложные проблемы для компьютеров неофициально известны как" AI-complete "или" AI-hard", подразумевая, что их решение эквивалентно общим способностям человеческого интеллекта или сильному ИИ, выходящим за рамки возможностей конкретного алгоритма.

Предполагается , что проблемы AI-complete включают общее компьютерное зрение , понимание естественного языка и работу с неожиданными обстоятельствами при решении любой проблемы реального мира.

AI-полные проблемы нельзя разрешить с настоящей компьютерной технологией самостоятельно, и также требуют людского вычисления . Это свойство может быть полезно, например, для проверки на присутствие людей, как это делают капчи; и для компьютерной безопасности, чтобы отразить атаки грубой силы .

Классический ИИ[править]

Главная статья: История искусственного интеллекта

Современные исследования ИИ начались в середине 1950-х годов. первое поколение исследователей ИИ было убеждено, что искусственный интеллект вообще возможен и что он будет существовать всего за несколько десятилетий. Саймон писал в 1965 году: "машины будут способны в течение двадцати лет выполнять любую работу, которую может выполнить человек." их предсказания были вдохновением для характера Стэнли Кубрика и Артура Кларка HAL 9000 , который воплотил то, что исследователи ИИ считали, что они могут создать к 2001 году. Пионер AI Марвин Минский был консультантом о проекте сделать HAL 9000 как можно более реалистичным в соответствии с прогнозами консенсуса того времени; Кревье цитирует его, как сказал по этому вопросу в 1967 году: "в течение одного поколения ... проблема создания "искусственного интеллекта" будет существенно решена " [23], хотя Минский утверждает, что он был неверно процитирован.[ цитата необходима]

Однако в начале 1970-х годов стало очевидно, что исследователи сильно недооценили сложность проекта. Финансирующие агентства стали скептически относиться к AGI и подвергли исследователей все большему давлению для создания полезного "прикладного ИИ". в начале 1980-х годов японский компьютерный проект пятого поколения возродил интерес к AGI, установив десятилетний график, который включал цели AGI, такие как "вести случайный разговор". в ответ на это и успех экспертных систем , как промышленность, так и правительство закачивали деньги обратно в поле. Однако в конце 1980-х годов доверие к ИИ резко пошатнулось, и цели компьютерного проекта пятого поколения так и не были достигнуты. во второй раз за последние 20 лет исследователи ИИ, предсказавшие неминуемое достижение ИИ, оказались в корне ошибочными . К 1990-м годам исследователи ИИ завоевали репутацию людей, которые дают напрасные обещания. Они стали неохотно делать предсказания вообще и избегать любого упоминания об искусственном интеллекте "человеческого уровня" из-за страха быть названным "диким мечтателем[s]."

Текущее узкое исследование ИИ[править]

Главная статья: Искусственный интеллект

В 1990-х и начале 21-го века господствующий ИИ достиг гораздо большего коммерческого успеха и академической респектабельности, сосредоточив внимание на конкретных подзадачах, где они могут давать поддающиеся проверке результаты и коммерческие приложения , такие как искусственные нейронные сети, компьютерное зрение или интеллектуальный анализ данных .[30]] Эти "прикладные системы AI" теперь использованы обширно повсеместно в индустрия технологии, и исследование в этом ключе очень тяжело финансировано как в Академии, так и в индустрии. В настоящее время разработка на этом месторождении считается наметившейся тенденцией, и ожидается, что через более чем 10 лет наступит зрелый этап.

Большинство основных исследователей ИИ надеются , что сильный ИИ может быть разработан путем объединения программ, которые решают различные подзадачи, используя интегрированную архитектуру агентов, когнитивную архитектуру или архитектуру субсумпций . Ханс Моравец писал в 1988 году:

"Я уверен, что этот восходящий путь к искусственному интеллекту однажды встретится с традиционным нисходящим маршрутом более чем на полпути, готовым обеспечить реальную компетентность и знания здравого смысла, которые были настолько разочаровывающе неуловимы в программах рассуждений. Полностью интеллектуальные машины приведут к тому, что метафорический золотой шип будет управляться, объединяя эти два усилия."

Однако даже эта фундаментальная философия была оспорена; например, Стеван Харнад из Принстона завершил свою статью 1990 года о гипотезе основания символа, заявив:

"Часто высказывалось предположение, что" нисходящие "(символические) подходы к моделированию познания каким-то образом встретятся с" восходящими " (сенсорными) подходами где-то посередине. Если обосновывающие соображения в этой статье справедливы, то это ожидание безнадежно модульно, и на самом деле существует только один жизнеспособный маршрут от смысла к символам: с нуля. Свободно плавающий символический уровень, подобный программному уровню компьютера, никогда не будет достигнут этим маршрутом (или наоборот) - и непонятно, почему мы должны даже пытаться достичь такого уровня, поскольку похоже, что получение там будет просто означать выкорчевывание наших символов из их внутренних значений (тем самым просто сводя себя к функциональному эквиваленту программируемого компьютера)."

Исследование искусственного общего интеллекта[править]

Искусственный общий интеллект [34] (AGI) описывает исследование, которое стремится создать машины, способные к общему интеллектуальному действию. Этот термин был использован еще в 1997 году Марком Губрудом [35] при обсуждении последствий полностью автоматизированного военного производства и операций. Термин был повторно введен и популяризирован шейном Леггом и Беном Герцелем около 2002 года.[36] цель исследования намного старше, например, проект Cyc Дуга Лената (который начался в 1984 году) и Allen Newell'S Soar проект рассматривается в рамках AGI. Исследовательская деятельность AGI в 2006 была описана Pei Wang и Бен Герцелем [37] как "подготовка публикаций и предварительных результатов". Первая летняя школа в аги была организована в Сямыне, Китай, в 2009 году Лабораторией искусственного мозга Сямэньского университета и OpenCog. Первый университетский курс был дан в 2010 и 2011 годах в Пловдивском университете, Болгария Тодором Арнаудовым. MIT представил курс в AGI в 2018 году, организованный Лексом Фридманом и с участием ряда приглашенных лекторов. Однако до сих пор большинство исследователей ИИ уделяли мало внимания AGI, а некоторые утверждали, что интеллект слишком сложен, чтобы быть полностью воспроизведенным в ближайшем будущем. Тем не менее, небольшое количество компьютерных ученых активно участвуют в исследованиях AGI, и многие из этой группы вносят вклад в серию конференций AGI . Исследования чрезвычайно разнообразны и часто носят новаторский характер. В предисловии к своей книге Goertzel говорит, что оценки времени, необходимого для по-настоящему гибкий аги построен отличаться от 10 лет для более века, но единого мнения в аги научного сообщества, кажется, что сроки обсуждаются Рэй Курцвейл в сингулярность уже близко (т. е. в период с 2015 по 2045) правдоподобно.

Однако большинство основных исследователей ИИ сомневаются, что прогресс будет таким быстрым. организации, явно преследующие AGI, включают швейцарскую лабораторию IDSIA AI, nnaisense, [39] Vicarious, Maluuba, Фонд OpenCog, адаптивный AI , LIDA, и Numenta и связанный Институт неврологии красного дерева . кроме того, были основаны такие организации, как научно-исследовательский институт машинного интеллекта и OpenAI , чтобы влиять на путь развития AGI. Наконец, такие проекты, как проект человеческого мозга есть цель построения функционирования моделирования человеческого мозга. В 2017 году опрос AGI классифицировал сорок пять известных "активных научно-исследовательских проектов", которые явно или неявно (через опубликованные исследования) исследуют AGI , причем самыми большими тремя являются DeepMind, проект человеческого мозга и Статья на основе OpenAI.

А именно DeepMind с их успехом в симуляции человеческого игрока для e.G AlphaGo использовал новые концепции:

- Усиление обучения для улучшения уже обученных сетей с новыми данными или

- Неконтролируемое обучение, e.G по генеративной состязательной сети, чтобы улучшить сети по конкуренции.

Вычислительная мощность, необходимая для имитации мозга[править]

Эмуляция всего мозга[править]

Главная статья: Загрузка разума

Популярный подход, обсуждаемый для достижения общего интеллектуального действия, - это эмуляция всего мозга . Низкоуровневая модель мозга строится путем сканирования и детального отображения биологического мозга и копирования его состояния в компьютерную систему или другое вычислительное устройство. Компьютер запускает имитационную модель, настолько верную оригиналу, что она будет вести себя по существу так же, как оригинальный мозг, или для всех практических целей, неразличимо.Эмуляция всего мозга обсуждается в вычислительной нейробиологии и нейроинформатике, в контексте моделирования мозга для медицинских исследований. Это обсуждается в исследованиях искусственного интеллекта Как подход к сильному ИИ. Технологии нейровизуализации, которые могли бы обеспечить необходимое детальное понимание, быстро улучшаются, и футурист Рэй Курцвейл в книге сингулярность близка предсказывает, что карта достаточного качества станет доступной на аналогичной шкале времени для требуемой вычислительной мощности.

Ранние оценки[править]

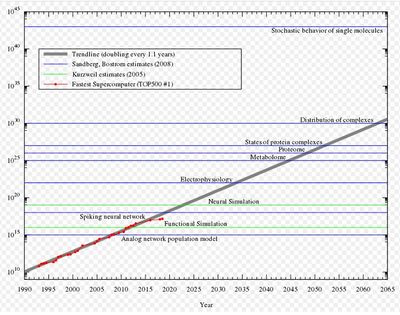

Для низкоуровневого моделирования мозга потребуется чрезвычайно мощный компьютер. Человеческий мозг имеет огромное количество синапсов . Каждый из 10 11 (ста миллиардов) нейронов имеет в среднем 7 000 синаптических связей с другими нейронами. Было подсчитано, что мозг трехлетнего ребенка имеет около 10 15 синапсов (1 квадриллион). Это число уменьшается с возрастом, стабилизируясь к взрослой жизни. Оценки варьируются для взрослого человека, начиная от 10 14 до 5×10 14 синапсов (от 100 до 500 триллионов). оценка вычислительной мощности мозга, основанная на простой модели переключения для активности нейронов, составляет около 1014 (100 триллионов) синаптических обновлений в секунду (SUPS ). В 1997 году Курцвейл рассмотрел различные оценки аппаратных средств, необходимых для того, чтобы сравниться с человеческим мозгом, и принял цифру 10 16 вычислений в секунду (cps). (для сравнения, если бы" вычисление "было эквивалентно одной" операции с плавающей запятой "- мера, используемая для оценки текущих суперкомпьютеров-то 10 16 "вычислений" были бы эквивалентны 10 петафлопс, достигнутым в 2011). Он использовал эту цифру, чтобы предсказать, что необходимое оборудование будет доступно где-то между 2015 и 2025 годами, если экспоненциальный рост мощности компьютера на момент написания статьи продолжится.

Моделирование нейронов более подробно[править]

Модель искусственного нейрона, принятая Курцвейлом и используемая во многих современных реализациях искусственных нейронных сетей, проста по сравнению с биологическими нейронами . Моделирование мозга, вероятно, должно было бы захватить подробное клеточное поведение биологических нейронов в настоящее время понимается только в самых общих чертах. Накладные расходы, вносимые полным моделированием биологических, химических и физических деталей нейронного поведения (особенно в молекулярном масштабе), потребуют вычислительных мощностей на несколько порядков больше, чем оценка Курцвейла. Кроме того , оценки не учитывают глиальные клетки, которые, по крайней мере, так же многочисленны, как нейроны, и которые могут численно превосходить нейроны на целых 10:1, и, как теперь известно, играют роль в когнитивных процессах

Текущее исследование[править]

Есть несколько исследовательских проектов, которые исследуют моделирование мозга с использованием более сложных нейронных моделей, реализованных на обычных вычислительных архитектурах. В 2005 году в рамках проекта "система искусственного интеллекта" было проведено моделирование "мозга" (10 11 нейронов) в режиме реального времени. Потребовалось 50 дней на кластере из 27 процессоров для имитации 1 секунды модели.[51] проект Blue Brain использовал одну из самых быстрых суперкомпьютерных архитектур в мире, платформу голубых генов IBM, для создания моделирования в реальном времени одной неокортикальной колонки крысы состоит примерно из 10 000 нейронов и 10 8 синапсов в 2006 году.Более долгосрочная цель состоит в том, чтобы построить детальное, функциональное моделирование физиологических процессов в человеческом мозге: "невозможно построить человеческий мозг , и мы можем сделать это через 10 лет", - сказал Генри Маркрам, директор проекта Blue Brain в 2009 году на конференции TED в Оксфорде.[53] были также спорные требования моделировать мозг кошки . Нейрокремниевые интерфейсы были предложены в качестве альтернативной стратегии реализации, которая может масштабироваться лучше.[54]

Ханс Моравец обратился к приведенным выше аргументам ("мозг более сложный"," нейроны должны быть смоделированы более подробно") в своей статье 1997 года " когда компьютерное оборудование будет соответствовать человеческому мозгу?".[55] он измерил способность существующего программного обеспечения моделировать функциональность нервной ткани, в частности сетчатки. Его результаты не зависят ни от количества глиальных клеток, ни от того, какие виды обработки нейронов выполняют где.

Фактическая сложность моделирования биологических нейронов была исследована в проекте OpenWorm, который был направлен на полное моделирование червя, который имеет только 302 нейронов в своей нейронной сети (среди около 1000 клеток в общей сложности). Нейронная сеть животного была хорошо документирована до начала проекта. Однако, хотя вначале задача казалась простой, модели, основанные на общей нейронной сети, не работали. В настоящее время усилия сосредоточены на точной эмуляции биологических нейронов (частично на молекулярном уровне), но результат пока нельзя назвать полным успехом. Даже если количество вопросов, которые нужно решить в модели человеческого мозга, не пропорционально количеству нейронов, объем работы по этому пути очевиден.

Осложнения и критические замечания к подходам ИИ, основанным на моделировании[править]

Фундаментальная критика подхода моделируемого мозга вытекает из воплощенного познания, где человеческое воплощение рассматривается как существенный аспект человеческого интеллекта. Многие исследователи считают, что воплощение необходимо для обоснования смысла.Если эта точка зрения верна, любая полностью функциональная модель мозга должна охватывать не только нейроны (т. е. роботизированное тело). Герцель [38] предлагает виртуальное воплощение (например, Second Life), но пока не известно, будет ли этого достаточно.

Настольные компьютеры с микропроцессорами мощностью более 10 9 СП (нестандартный блок Курцвейла "вычисления в секунду", см. выше) доступны с 2005 года. Согласно оценкам мощности мозга, используемым Курцвейлом (и Моравеком), этот компьютер должен быть способен поддерживать симуляцию мозга пчелы, но, несмотря на некоторый интерес, такого моделирования не существует . Есть по крайней мере три причины для этого:

- Во-первых, модель нейрона кажется упрощенной (см. Следующий раздел).

- Во-вторых, недостаточно понимания высших когнитивных процессов , чтобы точно установить , с чем коррелирует нейронная активность мозга, наблюдаемая с использованием таких методов, как функциональная магнитно-резонансная томография.

- В-третьих, даже если наше понимание познания достаточно продвинется вперед, программы раннего моделирования, вероятно, будут очень неэффективными и поэтому потребуют значительно большего количества аппаратного обеспечения.

- В-четвертых, мозг организма, будучи критическим, может не быть подходящей границей для когнитивной модели. Чтобы смоделировать мозг пчелы, может быть необходимо смоделировать тело и окружающую среду. Тезис расширенного разума формализует философскую концепцию, а исследование головоногих продемонстрировало четкие примеры децентрализованной системы.

Кроме того, масштаб человеческого мозга в настоящее время не ограничен. По одной из оценок человеческий мозг имеет около 100 миллиардов нейронов и 100 триллионов синапсов.Другая оценка-86 миллиардов нейронов, из которых 16,3 миллиарда находятся в коре головного мозга и 69 миллиардов-в мозжечке . Глиальные клеточные синапсы в настоящее время неквантифицированы, но, как известно, чрезвычайно многочисленны.

Исследование искусственного сознания[править]

Главная статья: Искусственное сознание

Хотя роль сознания в сильном AI / AGI спорна, многие исследователи AGI рассматривают исследование, которое исследует возможности реализации сознания, как жизненно важное. В начале своей работы Игорь Александер утверждал, что принципы создания сознательной машины уже существуют, но потребуется сорок лет, чтобы обучить такую машину понимать язык .

Отношения к "сильному ИИ"[править]

См. также: философия искусственного интеллекта, тест Тьюринга и Китайская комната

В 1980 году философ Джон Сирл придумал термин "сильный ИИ"как часть своего китайского аргумента.Он хотел провести различие между двумя различными гипотезами об искусственном интеллекте:

- Система искусственного интеллекта может думать и иметь разум . (Слово " ум "имеет особое значение для философов, как используется в" проблеме тела ума "или "философии ума".)

- Система искусственного интеллекта может (только) действовать так, как она думает и имеет ум.

Первая из них называется "сильной гипотезой ИИ", а вторая - "слабой гипотезой ИИ", потому что первая делает более сильное утверждение: она предполагает, что с машиной произошло что-то особенное, что выходит за рамки всех ее возможностей, которые мы можем проверить. Сирл назвал "сильную гипотезу ИИ" "сильным ИИ". Это использование также распространено в академических исследованиях и учебниках по искусственному интеллекту.

Слабая гипотеза ИИ эквивалентна гипотезе о возможности искусственного общего интеллекта. По словам Рассела и Норвига , "большинство исследователей ИИ считают слабую гипотезу ИИ само собой разумеющимся и не заботятся о сильной гипотезе ИИ."

В отличие от Сирла, Курцвейл использует термин "сильный ИИ" для описания любой системы искусственного интеллекта, которая действует так, как будто у нее есть ум, независимо от того, сможет ли философ определить, действительно ли у нее есть ум или нет.

Возможные объяснения медленного прогресса исследований ИИ[править]

См. также: История искусственного интеллекта § проблемы

С момента запуска исследований ИИ в 1956 году рост этой области замедлился с течением времени и застопорил цели создания машин, квалифицированных интеллектуальными действиями на человеческом уровне.Возможное объяснение этой задержки состоит в том, что компьютеры не имеют достаточного объема памяти или вычислительной мощности.Кроме того, уровень сложности, связанный с процессом исследований ИИ, может также ограничивать прогресс исследований ИИ .[69]

В то время как большинство исследователей ИИ считают, что сильный ИИ может быть достигнут в будущем, есть некоторые люди, такие как Хьюберт Дрейфус и Роджер Пенроуз, которые отрицают возможность достижения сильного ИИ. Джон Маккарти был одним из различных компьютерных ученых, которые считают, что ИИ человеческого уровня будет достигнут, но дата не может быть точно предсказана.[70]]

Концептуальные ограничения-еще одна возможная причина медлительности исследований ИИ.[69] исследователям ИИ, возможно, потребуется изменить концептуальные рамки своей дисциплины, чтобы обеспечить более прочную основу и вклад в поиски достижения сильного ИИ. Как писал Уильям Клоксин в 2003 году:"рамки начинаются с наблюдения Вайценбаума о том, что интеллект проявляется только относительно конкретных социальных и культурных контекстов".[69]

Кроме того, исследователи ИИ смогли создать компьютеры, которые могут выполнять сложные для людей задания, но, наоборот, они изо всех сил пытались разработать компьютер, который способен выполнять задачи, которые просты для людей, чтобы сделать [ пример необходим ] .Проблема, описанная Дэвидом Гелернтером, состоит в том, что некоторые люди считают мышление и рассуждение эквивалентными.[71] однако идея о том, изолированы ли мысли и создатель этих мыслей индивидуально, заинтриговала исследователей ИИ.[71]]

Проблемы, с которыми столкнулись в исследованиях ИИ за последние десятилетия, еще больше затруднили прогресс ИИ. Неудачные предсказания, которые были обещаны исследователями ИИ, и отсутствие полного понимания человеческого поведения помогли уменьшить основную идею ИИ человеческого уровня.[38] хотя прогресс исследований ИИ принес как улучшение, так и разочарование, Большинство исследователей установили оптимизм относительно потенциального достижения цели ИИ в 21 веке.[38]]

Другие возможные причины были предложены для длительных исследований в ходе сильного ИИ. Запутанность научных проблем и потребность полностью понять человеческий мозг через психологию и нейрофизиологию ограничили много исследователей от подражания функции человеческого мозга в компьютерное оборудование.[72] многие исследователи склонны недооценивать любые сомнения, связанные с будущими предсказаниями ИИ, но, не принимая эти проблемы всерьез, люди могут игнорировать решения проблемных вопросов.[38]]

Clocksin говорит, что концептуальное ограничение, которое может препятствовать прогрессу исследований ИИ, заключается в том, что люди могут использовать неправильные методы для компьютерных программ и внедрения оборудования.[69] когда исследователи ИИ впервые начали стремиться к цели искусственного интеллекта, главным интересом было человеческое мышление.Исследователи надеялись установить вычислительные модели человеческого знания через рассуждение и выяснить, как проектировать компьютер с определенной познавательной задачей.[73]

Практика абстракции, которую люди склонны переопределять при работе с конкретным контекстом в исследованиях, дает исследователям концентрацию всего на нескольких концепциях.[73] наиболее продуктивное использование абстракции в исследованиях ИИ исходит из планирования и решения проблем.[73] хотя цель состоит в том, чтобы увеличить скорость вычисления, роль абстракции поставила вопросы об участии операторов абстракции.[74]

Возможная причина медлительности в ИИ связана с признанием многими исследователями ИИ, что эвристика-это раздел, который содержит значительное нарушение между производительностью компьютера и производительностью человека.Конкретные функции, которые запрограммированы на компьютере, могут быть в состоянии объяснить многие требования, которые позволяют ему соответствовать человеческому интеллекту. Эти объяснения не обязательно гарантированно являются фундаментальными причинами задержки в достижении сильного ИИ, но они широко согласованы многочисленными исследователями.

Было много исследователей ИИ, которые обсуждают идею о том, должны ли машины создаваться с эмоциями . В типичных моделях ИИ нет эмоций, и некоторые исследователи говорят, что программирование эмоций в машинах позволяет им иметь собственный ум.Эмоции суммируют переживания людей, потому что позволяют им помнить эти переживания.Дэвид Гелернтер пишет: "Ни один компьютер не будет творческим, если он не сможет имитировать все нюансы человеческих эмоций." Это беспокойство об эмоциях создало проблемы для исследователей ИИ, и оно связано с концепцией сильного ИИ по мере продвижения его исследований в будущее.

Сознание[править]

Есть и другие аспекты человеческого разума, кроме интеллекта, которые имеют отношение к концепции сильного ИИ, которые играют важную роль в научной фантастике и этике искусственного интеллекта:

- сознание: иметь субъективный опыт и мысль .[76]

- самосознание: осознавать себя как отдельного человека, особенно осознавать свои собственные мысли.

- чувствительность: способность" чувствовать " восприятие или эмоции субъективно.

- разумность: способность к мудрости.

Эти черты имеют моральное измерение, потому что машина с такой формой сильного ИИ может иметь законные права, аналогичные правам нечеловеческих животных . Кроме того , Билл Джой, среди прочего, утверждает, что машина с этими чертами может представлять угрозу для жизни или достоинства человека.[77] остается показать, необходимы ли какие-либо из этих признаков для сильного ИИ. Роль сознания не ясна, и в настоящее время нет согласованного теста на его присутствие. Если машина построена с помощью устройства, имитирующего нейронные корреляты сознания будет ли это автоматически иметь самосознание? Возможно также, что некоторые из этих свойств, такие как чувствительность, естественным образом возникают из полностью разумной машины, или что становится естественным приписывать эти свойства машинам, как только они начинают действовать явно разумным образом. Например, разумного действия может быть достаточно для восприятия, а не наоборот.

В научной фантастике AGI связан с такими чертами, как сознание , чувствительность , разумность и самосознание , наблюдаемые у живых существ. Однако, по мнению философа Джона Сирла, вопрос о том, достаточен ли общий интеллект для сознания, остается открытым. "Сильный ИИ" (как определено выше Рэем Курцвейлом ) не следует путать с "сильной гипотезой ИИ Сирла"."Сильная гипотеза ИИ-это утверждение, что компьютер, который ведет себя так же разумно, как человек, также обязательно должен иметь ум и сознание. AGI относится только к количеству интеллекта, которое показывает машина, с умом или без него.

Споры и опасности[править]

Осуществимость[править]

Мнения различаются как о том, когда и когда прибудет искусственный интеллект. С одной стороны, Пионер ИИ Герберт А. Саймон писал в 1965 году:"машины будут способны в течение двадцати лет выполнять любую работу, которую может сделать человек". Однако это предсказание не сбылось. Соучредитель Microsoft Пол Аллен считал, что такой интеллект маловероятен в 21 веке, потому что для этого потребуются "непредвиденные и принципиально непредсказуемые прорывы" и "научно глубокое понимание познания".[78] запись в The Guardian робототехник Алан Уинфилд утверждал, что пропасть между современными вычислениями и искусственным интеллектом человеческого уровня столь же широка, как пропасть между текущим космическим полетом и практическим космическим полетом быстрее, чем свет.[79]] Мнения экспертов AI о целесообразности AGI wax и wane, и, возможно, видели возрождение в 2010-х годах. Четыре опроса, проведенные в 2012 и 2013 годах, показали, что среднее предположение среди экспертов о том, когда они будут на 50% уверены, что AGI прибудет, было от 2040 до 2050, в зависимости от опроса, со средним значением 2081. Интересно также отметить, что 16,5% экспертов ответили "никогда" на один и тот же вопрос, но с уверенностью 90%. Дальнейшие текущие соображения по прогрессу AGI можно найти ниже тестов для подтверждения AGI на уровне человека и IQ-тестов AGI .

Потенциальная угроза человеческому существованию[править]

Главная статья: экзистенциальный риск от искусственного интеллекта См. также: технологическая особенность

Создание искусственного общего разума может иметь последствия настолько большие и сложные, что невозможно предсказать, что произойдет потом. Таким образом , событие в гипотетическом будущем достижения сильного ИИ называют технологической сингулярностью, потому что теоретически его невозможно увидеть. Но это не помешало философам и исследователям угадать, что могут сделать умные компьютеры или роботы будущего, включая формирование утопии, будучи нашими друзьями или подавляя нас в поглощении ИИ . Последняя потенциальность особенно тревожна, поскольку она создает экзистенциальный риск для человечества .

Самореплицирующиеся машины[править]

Умные компьютеры или роботы смогут проектировать и производить улучшенные версии самих себя.Растущая популяция разумных роботов могла бы, по-видимому, конкурировать с низшими людьми на рынках труда, в бизнесе, в науке, в политике (преследуя права роботов) и технологически, социологически ( действуя как один) и в военном отношении . Даже в наши дни многие рабочие места уже заняты псевдоинтеллектуальными машинами, работающими на слабом ИИ. Например, роботы для дома, здравоохранения, отелей и ресторанов автоматизировали многие части нашей жизни: виртуальные боты превращают обслуживание клиентов в самообслуживание, приложения для больших данных AI используются для замены менеджеров портфолио, а социальные роботы, такие как Pepper, используются для замены людей, встречающих для обслуживания клиентов.

Эмерджентный суперинтеллект[править]

Если бы исследование сильного ИИ производило достаточно интеллектуальное программное обеспечение, оно смогло бы перепрограммировать и улучшить себя – функция, называемая "рекурсивным самосовершенствованием". В этом случае он будет еще лучше совершенствовать себя и, вероятно, продолжит делать это в быстро растущем цикле, что приведет к взрыву интеллекта и появлению суперинтеллекта . Такой интеллект не имел бы ограничений человеческого интеллекта и мог бы изобрести или открыть почти все.

Гиперинтеллектуальное программное обеспечение может не обязательно решить поддерживать продолжение существования человечества и может быть чрезвычайно трудно остановить.Эта тема также недавно начала обсуждаться в научных публикациях как реальный источник рисков для цивилизации, людей и планеты Земля .

Одно из предложений для решения этой проблемы заключается в том, чтобы убедиться, что первый в целом интеллектуальный ИИ является дружественным ИИ, который затем будет стремиться к тому, чтобы впоследствии разработанные ИИ были также хороши для нас. Но дружественный ИИ сложнее создать, чем простой ИИ, и поэтому, вероятно, в гонке между ними, этот не дружественный ИИ будет разработан первым. Кроме того, нет никакой гарантии, что дружественный ИИ останется дружелюбным или что его потомство также будет хорошим.

См. также[править]

- Автоматизированное машинное обучение

- Машинная этика

- Многозадачное обучение

- Сверхразум

- Ник Бостром

- Институт будущего человечества

- Схема искусственного интеллекта

- Искусственный мозг

- Передача обучения

- Очерк трансгуманизма

- Общая игра

- Синтетический интеллект

- Усиление интеллекта (IA), использование информационных технологий в увеличении человеческого интеллекта вместо создания внешнего автономного " AGI"